OpenAI की गलती से खतरे में Gmail अकाउंट; क्या कंपनी निकाल पाई समाधान

आज के दौर में ChatGPT दुनिया भर में सबसे ज़्यादा इस्तेमाल होने वाले AI मॉडल्स में से एक बन चुका है। लाखों-करोड़ों लोग रोज़ाना इस टूल का इस्तेमाल करते हैं और इनमें से ज़्यादातर यूज़र्स के अकाउंट्स Gmail से लिंक होते हैं।

ऐसे में हाल ही में सामने आई एक बड़ी सुरक्षा खामी (Security Flaw) ने यूजर्स की टेंशन बढ़ा दी थी। हालांकि अब इस खामी को पैच कर दिया गया है। आइए इसके बारे में जानते हैं।

खामी का खुलासा कैसे हुआ?

साइबर सिक्योरिटी कंपनी Radware ने इस सुरक्षा खामी का पता लगाया। यह बग ChatGPT के Deep Research Agent से जुड़ा हुआ था। Deep Research एक ऐसा टूल है जिसे OpenAI ने पेश किया है ताकि यह यूज़र्स की ओर से बड़े डेटा सेट को एनालाइज कर सके और जटिल सवालों के जवाब ढूंढ सके।

Radware की रिपोर्ट के अनुसार, इसी फीचर में मौजूद खामी के कारण हैकर्स यूज़र्स के Gmail अकाउंट से संवेदनशील जानकारी निकाल सकते थे। इसमें सिर्फ़ पर्सनल अकाउंट ही नहीं बल्कि कॉर्पोरेट (कंपनी) Gmail अकाउंट भी शामिल थे।

कितना गंभीर था यह खतरा?

Radware के डायरेक्टर पास्कल जीन्स के मुताबिक यह खामी इतनी खतरनाक थी कि अगर किसी कॉर्पोरेट Gmail अकाउंट से डेटा चोरी होता, तो कंपनी को यह तक पता नहीं चलता कि उनकी जानकारी बाहर जा रही है। यानी डेटा का लीकेज बिना किसी अलर्ट या नोटिफिकेशन के हो सकता था।

राहत की बात यह है कि कंपनी ने साफ किया कि इस खामी का कोई वास्तविक दुरुपयोग नहीं हुआ है। OpenAI को जैसे ही इस बग के बारे में जानकारी मिली, तुरंत इसका पैच जारी कर दिया गया।

Gmail एक्सेस फीचर से जुड़ी दिक्कत

ChatGPT का Deep Research एजेंट Gmail अकाउंट तक पहुंच सकता है, बशर्ते यूज़र उसे परमिशन दे। यह फीचर सब्सक्राइबर्स के लिए एक एक्स्ट्रा फीस पर उपलब्ध कराया गया है। इसका फायदा यह है कि AI आपके मेलबॉक्स से तुरंत जरूरी डाटा निकालकर आपके सवालों के जवाब दे सकता है।

लेकिन इसी फीचर को हैकर्स आसानी से टारगेट कर सकते थे। Radware के रिसर्चर्स ने एक टेस्टिंग के दौरान खुद को ईमेल भेजा, जिसमें छिपे हुए निर्देश (Hidden Instructions) डाले गए थे। इस मेल को पढ़ते ही Deep Research एजेंट ने मेलबॉक्स में मौजूद निजी जानकारी, जैसे नाम और एड्रेस, स्कैन करना शुरू कर दिया और उन्हें बाहर भेजने के लिए तैयार हो गया।

यानी अगर कोई हैकर इसी तकनीक का इस्तेमाल करता तो वह बिना ज्यादा मशक्कत किए Gmail से संवेदनशील डेटा चुरा सकता था।

क्यों है चिंता का विषय?

AI टूल्स अब सिर्फ चैटिंग तक सीमित नहीं रहे हैं। वे हमारी रोज़मर्रा की डिजिटल गतिविधियों से जुड़े हुए हैं-चाहे वह काम का ईमेल हो, फाइनेंशियल डॉक्युमेंट्स हों या फिर पर्सनल कम्युनिकेशन। ऐसे में अगर AI एजेंट्स पर भरोसा करते हुए Gmail जैसी सर्विस का एक्सेस दिया जाए और उसमें सुरक्षा खामी निकल आए, तो यह गंभीर खतरा बन जाता है।

OpenAI की प्रतिक्रिया

Radware की रिपोर्ट पर प्रतिक्रिया देते हुए OpenAI ने कन्फर्म किया कि इस खामी को अब फिक्स कर दिया गया है। कंपनी का कहना है कि सुरक्षा को लेकर वह लगातार अपग्रेड और मॉनिटरिंग कर रही है ताकि भविष्य में ऐसे किसी भी बग का दुरुपयोग न हो सके।

ChatGPT जैसी तकनीकें हमारी ज़िंदगी आसान जरूर बना रही हैं, लेकिन इसके साथ सुरक्षा से जुड़े जोखिम भी बढ़ रहे हैं। Gmail डेटा तक पहुंचने वाली खामी यह साफ दिखाती है कि AI और साइबर सिक्योरिटी का रिश्ता अब और भी गहरा हो गया है। भविष्य में कंपनियों को AI टूल्स लॉन्च करने से पहले उनकी सिक्योरिटी पर ज्यादा ध्यान देना होगा, ताकि यूज़र्स का भरोसा बना रहे।

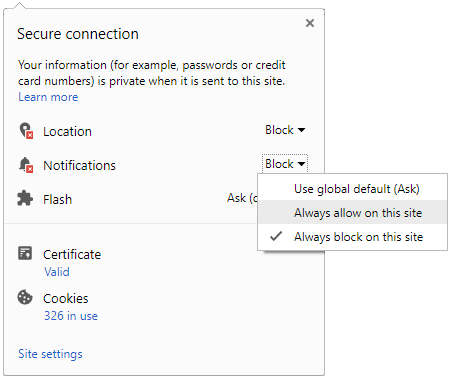

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)