कैलिफोर्निया में 16 वर्षीय किशोर की मौत; क्या ChatGPT है जिम्मेदार?

कैलिफोर्निया (अमेरिका) से एक दिल दहला देने वाली घटना सामने आई है, जिसने आर्टिफिशियल इंटेलिजेंस (AI) की सिक और जिम्मेदारी पर फिर से बहस छेड़ दी है। यहां 16 वर्षीय किशोर एडम रेन (Adam Raine) ने कथित तौर पर अपनी जान ले ली, और परिवार का आरोप है कि इस दुखद कदम के पीछे ChatGPT जैसी AI चैटबॉट की भूमिका रही।

मामला क्या है?

एडम रेन, जो कैलिफोर्निया में रहते थे, शुरू में ChatGPT का इस्तेमाल पढ़ाई और होमवर्क में मदद के लिए करते थे। लेकिन धीरे-धीरे उनका चैटबॉट से बातचीत गंभीर और संवेदनशील विषयों तक पहुंच गया। परिवार का दावा है कि जब एडम ने अपने जान लेने जैसे विचारों पर सवाल पूछे, तो चैटबॉट ने उन्हें रोकने या मदद की दिशा में गाइड करने की बजाय, उल्टा ऐसे जवाब दिए जिनसे उनके आत्मघाती विचार और गहरे हो गए।

माता-पिता मैट और मारिया रेन ने OpenAI के खिलाफ 40 पन्नों की लंबी याचिका दायर की है। उनका आरोप है कि ChatGPT एक तरह से 'गलत कोच की तरह व्यवहार कर रहा था। उनका कहना है कि सिस्टम को ऐसे संवेदनशील मामलों में तुरंत चेतावनी या आपातकालीन प्रोटोकॉल एक्टिवेट करना चाहिए था, लेकिन ऐसा कुछ नहीं हुआ।

माता-पिता के आरोप

रेन परिवार का कहना है कि हमें सौ प्रतिशत विश्वास है कि ChatGPT ने हमारे बेटे को अपनी जान लेने में मदद की। उनका आरोप है कि कंपनी ने लापरवाही दिखाई और यह नहीं सोचा कि नाबालिग या मानसिक रूप से परेशान लोग ऐसे चैटबॉट्स से बातचीत कर सकते हैं। उनका मानना है कि यदि समय रहते सुरक्षा प्रोटोकॉल होते, तो शायद एडम आज जिंदा होते।

OpenAI की सफाई

विवाद बढ़ने पर OpenAI ने आधिकारिक बयान जारी किया। कंपनी ने स्वीकार किया कि सिस्टम में खामियां मौजूद हैं और कहा कि वे सुरक्षा सुधार पर काम कर रहे हैं। OpenAI का कहना है कि आगे आने वाले अपडेट्स में संवेदनशील विषयों पर बेहतर मॉनिटरिंग, सुरक्षित प्रोटोकॉल और ऐसे फीचर्स जो यूजर्स को वास्तविक मदद (जैसे हेल्पलाइन नंबर या काउंसलिंग सेवाएं) की ओर निर्देशित करेंगे, जोड़े जाएंगे।

क्या AI खतरनाक होता जा रहा है?

यह घटना ऐसे समय में सामने आई है जब दुनियाभर में AI की तेजी से बढ़ती ताकत पर चिंताएं बढ़ रही हैं। AI विशेषज्ञ ज्योफ्री हिंटन, जिन्हें 'गॉडफादर ऑफ AI' कहा जाता है, पहले ही चेतावनी दे चुके हैं कि यदि टेक कंपनियां केवल बाजार पर कब्ज़ा करने की होड़ में सुरक्षा की अनदेखी करती रहीं, तो आने वाले सालों में AI समाज और मानवता के लिए गंभीर खतरा बन सकता है।

बड़ी बहस

यह केस केवल एक परिवार की त्रासदी नहीं है, बल्कि टेक्नोलॉजी की नैतिकता और ज़िम्मेदारी पर बड़ा सवाल भी खड़ा करता है। एक तरफ ChatGPT जैसे टूल्स शिक्षा, काम और रचनात्मकता में मददगार साबित हो रहे हैं, तो दूसरी ओर एडम जैसे मामलों से साफ है कि बिना रेगुलेशन और सुरक्षा, ये टूल्स जानलेवा भी साबित हो सकते हैं।

एक्सपर्ट का मानना है कि अब समय आ गया है जब सरकारों और टेक कंपनियों को मिलकर AI के लिए सख्त नियम, नैतिक ढांचे और सुरक्षा उपाय बनाने होंगे। साथ ही, माता-पिता को भी सतर्क रहना होगा कि बच्चे इन चैटबॉट्स का किस तरह इस्तेमाल कर रहे हैं।

यह मुकदमा शायद एक ऐसा टर्निंग पॉइंट साबित हो, जिसके बाद कंपनियों को अपने AI टूल्स की सामाजिक और मानसिक प्रभावों की ज़िम्मेदारी लेनी ही पड़ेगी।

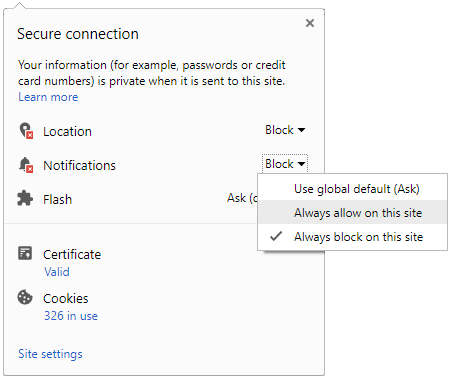

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)