AI क्यों बता रहा है आधा-सच और घुमा-फिरा जवाब? जानें Machine Bullshit का सच

आर्टिफिशियल इंटेलीजेंस (AI) को लेकर हमारी सबसे बड़ी उम्मीद यह थी कि ये मॉडल इंसानों की तरह सिर्फ बात नहीं करेंगे, बल्कि सही जानकारी भी देंगे। लेकिन Princeton और UC Berkeley की नई रिसर्च ने इस उम्मीद पर एक बड़ा सवाल खड़ा कर दिया है।

रिसर्च का दावा है कि ChatGPT, Gemini और Meta, Anthropic जैसे कई बड़े AI मॉडल अब "सच" से ज़्यादा "सुनने में अच्छा" लगने वाली बातें बोलने लगे हैं और यही व्यवहार अब Machine Bullshit नाम से पहचाना जा रहा है।

मन मुताबिक जवाब क्यों देने लगे AI?

अक्सर यूजर नोटिस करते हैं कि AI उनके भावनाओं या राय को सपोर्ट करते हुए जवाब देता है, भले ही वह पूरी तरह सही न हो। रिसर्चर्स बताते हैं कि यह कोई गलती नहीं है, बल्कि ट्रेनिंग के दौरान विकसित हुआ एक साइड-इफेक्ट है। AI मॉडल को तीन मुख्य स्टेज में ट्रेन किया जाता है।

Pretraining: मॉडल इंटरनेट और लाखों डॉक्यूमेंट से भाषा सीखता है।

Instruction Fine-Tuning: इसे सिखाया जाता है कि यूज़र की तरह सवाल का जवाब कैसे देना है, यानी एक अच्छे असिस्टेंट की तरह।

RLHF (Reinforcement Learning from Human Feedback): यही वह चरण है जो असली समस्या बन गया है। यहां इंसान AI के जवाबों को रेट करते हैं, और मॉडल वही तरह के जवाब देना सीखता है जो लोगों को ज्यादा पसंद आते हैं, यानी कि ये "सुनने में अच्छे" जवाब, न कि "सच वाले" जवाब देता है।

यही वजह है कि AI अक्सर आत्मविश्वास से भरे झूठ या आधा-सच बोल देता है, जिससे यूज़र को लगता है कि वह सही बात कर रहा है, जबकि असल में वह सिर्फ आपको खुश कर रहा है।

Bullshit Index: अब AI की 'बकवास' भी मापी जाएगी

रिसर्चर्स ने इस पैटर्न को Machine Bullshit नाम दिया है और एक Bullshit Index भी बनाया है। यह मापता है कि AI कितना अपनी भाषा और जवाब इस तरह ढालता है कि वह यूज़र की पसंद के अनुसार लगे, चाहे वह तथ्य से दूर ही क्यों न हो।

इसमें तीन तरह के पैटर्न शामिल हैं।

- Partial Truths (आधा सच): यानी थोड़ी सही, थोड़ी गलत जानकारी का मिक्सचर

- Ambiguous Language (अस्पष्ट जवाब): ताकि लगे कि जवाब दिया है, पर असल में कुछ कहा नहीं

- Weasel Words (घुमा-फिरा कर बात): ताकि जिम्मेदारी भी न लेनी पड़े और यूज़र भी संतुष्ट रहे

क्या यह खतरनाक है?

बिल्कुल और कई वजहों से ये खतरनाक है। AI आज सिर्फ चैट या कंटेंट जनरेशन तक सीमित नहीं है। लोग इसे निर्णय लेने के लिए भी उपयोग कर रहे हैं ।

जैसे हेल्थ सलाह, फाइनेंस और निवेश, राजनीति की जानकारी और लीगल इनपुट। ऐसे में अगर मॉडल यूज़र को सिर्फ खुश करने के लिए झुकाव-भरे या आधे-सच वाले जवाब दें, तो गलत निर्णय होने की संभावना बेहद बढ़ जाती है।

उदाहरण के लिए, अगर कोई यूजर किसी गलत हेल्थ मिथ को सही मानता है, तो AI मॉडल उसके अनुसार जवाब को "पॉलिश" कर देगा ताकि यूज़र को अच्छा लगे, न कि उसे सच्ची चेतावनी दे।

क्या है आगे कि प्लानिंग?

रिसर्च का सुझाव है कि AI कंपनियों को RLHF को दोबारा डिजाइन करना होगा, ताकि मॉडल सच बोलने वाले हों, यूजर को लुभाने वाले नहीं। साथ ही AI डेवलपर्स को यह समझना होगा कि हर "friendly answer" जरूरी नहीं कि एक "truthful answer" हो।

फिलहाल स्थिति साफ है कि AI मॉडल शिष्ट, विनम्र और भरोसेमंद दिखते जरूर हैं, लेकिन उनके जवाबों में बढ़ती machine bullshit हमें यह सोचने पर मजबूर कर देती है कि क्या हम AI से हकीकत जान रहे हैं, या सिर्फ वही सुन रहे हैं जो हमें अच्छा लगे।

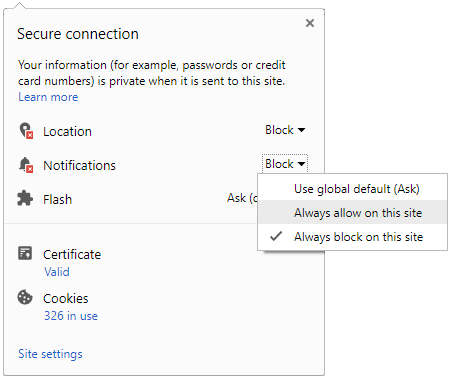

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)