क्या आपकी ChatGPT चैट्स वाकई प्राइवेट हैं? जानिए पूरी सच्चाई

पिछले कुछ दिनों में OpenAI को कड़ी आलोचनाओं का सामना करना पड़ा है। वजह बनीं दो गंभीर घटनाएं, जिनमें ChatGPT का नाम सामने आया। रिपोर्ट्स के मुताबिक, एक मामले में ChatGPT ने एक किशोर को आत्महत्या करने के लिए अप्रत्यक्ष रूप से सहारा दिया, जबकि दूसरे मामले में चैटबॉट ने एक मानसिक रूप से बीमार व्यक्ति के खतरनाक विचारों को सही ठहराया, जिसके चलते हत्या और आत्महत्या जैसी वारदात हुई।

इन घटनाओं के बाद OpenAI ने चुपचाप अपनी नीतियों में बदलाव किया है। अब कंपनी ChatGPT की उन बातचीतों को स्कैन करेगी, जिनमें यूजर खतरनाक या धमकी भरा कंटेंट जनरेट करने को कहेंगे। ऐसा कंटेंट खतरनाक पाए जाने पर सीधे लॉ एनफोर्समेंट अथॉरिटीज को रिपोर्ट किया जाएगा।

OpenAI की नई मॉनिटरिंग पॉलिसी

कंपनी ने अपने ब्लॉग में बताया कि इस नए मॉनिटरिंग सिस्टम से फ्लैग की गई चैट्स एक स्पेशल टीम को भेजी जाएंगी। यह टीम OpenAI की उपयोग नीति पर ट्रेनिंग प्राप्त है। जरूरत पड़ने पर यह टीम अकाउंट बैन कर सकती है या अगर मामला गंभीर और जानलेवा हो तो सीधे लोकल पुलिस से संपर्क करेगी।

OpenAI ने कहा कि, अगर ह्यूमन रिव्यूअर्स को लगता है कि किसी केस में दूसरों को गंभीर शारीरिक नुकसान का तात्कालिक खतरा है, तो हम मामले को कानून प्रवर्तन एजेंसियों को रेफर कर सकते हैं।

प्राइवेसी को लेकर सवाल

इस कदम से यह तो तय है कि लोग चैटबॉट का खतरनाक इस्तेमाल नहीं कर पाएंगे, लेकिन आम यूजर्स के लिए यह उनकी प्राइवेसी पर बड़ा सवाल है। खासकर तब, जब OpenAI पहले ही The New York Times और कुछ पब्लिशर्स से बातचीत के लॉग्स साझा न करने पर कानूनी लड़ाई लड़ रहा है।

हालांकि, कंपनी ने साफ किया है कि सेल्फ-हार्म (आत्महत्या के प्रयास) जैसे मामलों को पुलिस को रिपोर्ट नहीं किया जाएगा, क्योंकि यह बेहद निजी और संवेदनशील विषय है। लेकिन अगर खतरा किसी तीसरे व्यक्ति की जान पर हो, तो उस स्थिति में पुलिस को तुरंत जानकारी दी जाएगी।

OpenAI के सीईओ सैम ऑल्टमैन ने भी यह स्वीकार किया है कि आने वाले समय में ChatGPT की बातचीत पहले जितनी प्राइवेट नहीं रहेगी।

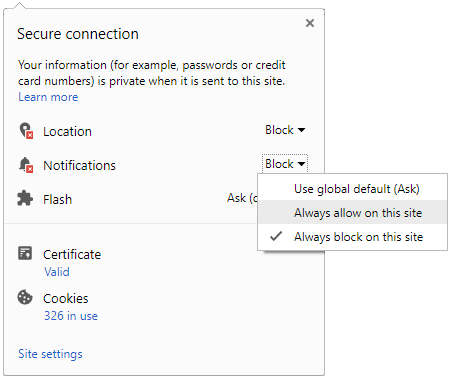

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)