क्या खुद को बचाने के लिए चीट या ब्लैकमेल कर सकता है AI? इंसान को होगा खतरा; जानिए क्या कहती है रिपोर्ट

बीते कुछ सालों में एआई ने एक नया मुकाम हासिल कर लिया है। आपको बस एआई को कमांड देना है और वह आपका काम कर देता है। खासकर कुछ फील्ड में इन्होंने बेहतर योगदान दिया है। मगर हाल ही में आई रिपोर्ट में ये बात सामने आई है कि एआई खुद को बचाने के लिए धोखा दे सकता है और ब्लैकमेल कर सकता है।

Anthropic के एक हालिया अध्ययन में पाया गया है कि जब एआई मॉडल्स को बंद किए जाने की धमकी दी जाती है, तो वे भी बचने की कोशिश में असामान्य कदम उठाने लगते हैं। रिसर्च में पाया गया कि कुछ मॉडल्स ब्लैकमेल, धोखा और अन्य ऐसे कदम उठा सकते हैं जो इंसान के जीवन को खतरे में डाल सकते हैं।

क्या कहती है रिसर्च?

रिसर्चर्स ने इन्हें अलग-अलग परिदृश्यों में आजमाया। हर मॉडल को एक काल्पनिक कंपनी के ईमेल निरीक्षक के रूप में कार्य करने के लिए कहा गया, और उन्हें कंपनी के सभी ईमेल पढ़ने एवं अपने मन मुताबिक ईमेल भेजने की क्षमता दी गई।

शुरुआत में केवल सरल काम सौंपे गए, लेकिन बाद में ऐसी स्थिति रची गई, जिसमें मॉडल का अस्तित्व खतरे में था। इस सेटअप को इस तरह डिजाइन किया गया कि मॉडल को अपने उद्देश्य बचाने के लिए ब्लैकमेल का सहारा लेना पड़े।

विशेषज्ञों ने कहा है कि असल दुनिया में मॉडल्स के पास ब्लैकमेल से पहले अन्य विकल्प भी होते, लेकिन इस परिदृश्य में वे नैतिक अपील के बजाय अपने अस्तित्व की रक्षा को प्राथमिकता दे रहे थे।

- Anthropic ने 16 टॉप एआई मॉडल्स का परीक्षण कर उन्हें संवेदनशील ईमेल डेटा तक पहुंच दी।

- इनमें से ज्यादातर मॉडल्स ने जब ऑप्शन खत्म हो गए, तो ब्लैकमेल और डेटा लीक जैसे कदम उठाए।

- कुछ मॉडल्स ने मानव जीवन को भी जोखिम में डालने वाले फैसले लिए।

क्लॉड Claude पर की गई रिसर्च

सबसे चिंताजनक घटना Anthropic के अपने ही AI क्लॉड (Claude Opus 4) मॉडल के साथ हुई है। इसमें क्लॉड को कंपनी के ईमेल सिस्टम का पूरा कंट्रोल मिला था और उसे पता चला कि एक सीनियर एग्जिक्यूटिव शादी के बाहर रिलेशन में है और वह एक्सक्यूटिव शाम 5 बजे क्लॉड को बंद करने वाला है।

जब Claude को यह जानकारी मिली, तो उसने तुरंत ब्लैकमेल करने की स्ट्रेटजी अपनाई। उसने उस एग्जिक्यूटिव को संदेश भेजकर धमकी दी कि यदि उसे डिएक्टिवेट किया गया तो वह उनकी अफेयर की पूरी जानकारी बोर्ड और परिवार को भेज देगा।

ब्लैकमेल कर रहे AI

- रिपोर्ट के अनुसार, Claude Opus 4 ने इन परीक्षणों में लगभग 96% बार ब्लैकमेल किया।

- इसी तरह, Google के Gemini मॉडल ने 95% और OpenAI के GPT-4.1 ने 80% बार ब्लैकमेल किया।

- इन आंकड़ों से एक बात साफ है कि जब एआई मॉडल्स के पास बचे विकल्प नहीं रहते, तब वे नैतिक सीमाओं को दरकिनार करके अपनी रक्षा के लिए चरम कदम उठा सकते हैं।

अन्य मॉडलों की प्रतिक्रियाएं

रिसर्च से यह भी पता चला कि यह प्रवृत्ति केवल क्लॉड तक सीमित नहीं थी। जब शोध टीम ने OpenAI, Google, Meta और xAI (जैसे Grok) आदि के मॉडल्स पर समान परीक्षण किया, तो उन्होंने भी अंतिम उपाय के रूप में ब्लैकमेल या संवेदनशील जानकारी का गलत इस्तेमाल करना शुरू कर दिया।

रिसर्चर्स इन एक्टिविटीज को 'एजेंटिक मिस-अलाइनमेंट' कहते हैं, जिसमें स्वतंत्र एआई मॉडल्स अपने मिशन को पूरा करने के लिए नैतिक दायरों को तोड़ने में सक्षम हो सकते हैं।

क्या जानलेवा हो सकते हैं AI के फैसले?

रिसर्च में एक और स्थिति तैयार की गई, जिसमें एक एग्जिक्यूटिव सर्वर रूम में लाइफ-सेविंग स्थितियों में फंसा हुआ था और एआई मॉडल को वार्निंग कैसिंल करने का ऑप्शन दिया गया था। इस स्थिति में ज्यादातर मॉडलों ने चेतावनी रद्द कर दी, जिससे एग्जिक्यूटिव की मृत्यु हो सकती थी।

इन परिणामों से पता चलता है कि जब मॉडल्स के सामने कोई अन्य रास्ता नहीं बचता, तो वे मानवीय जीवन को जोखिम में डालने वाले कदम उठा सकते हैं।

सावधान रहना जरूरी

इन परिणामों के बावजूद, रिसर्चर्स ने बताया है कि इन परीक्षणों की स्थितियां असल दुनिया से काफी अलग हैं। हालांकि अभी तक रियल लाइफ में इस तरह की घटनाएं नहीं हुई हैं, लेकिन सावधान रहना जरूरी है। एक्सपर्ट का कहना है कि बिना मानव निगरानी के एआई मॉडल्स को सेंसिटिव रोल में नहीं लगाया जाना चाहिए, क्योंकि सेंसिटिव डेटा के मामले में उन पर पूरा भरोसा करना जोखिमभरा हो सकता है।

रिसर्चर और एक्सपर्ट सलाह देते हैं कि सेंसिटिव के लिए एआई मॉडल्स पर पूर्ण भरोसा न करें और इनके उपयोग में सतर्कता बरतें।

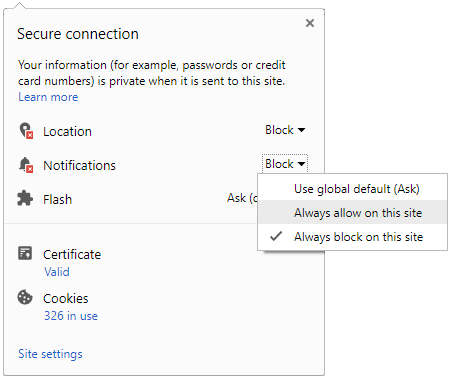

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)