ChatGPT और Perplexity पर शेयर की गई लिंक क्यों सेफ नहीं? फिशिंग साइट्स पर कर सकते डायरेक्ट

आर्टिफिशियल इंटेलिजेंस (AI) का इस्तेमाल पिछले कुछ सालों में तेजी से बढ़ा है, लेकिन इसके साथ-साथ ही यह लोगों के लिए खतरा भी बनता जा रहा है। ChatGPT, Gemini, Perplexity जैसे AI टूल्स न सिर्फ आम यूजर्स की जिंदगी का हिस्सा बन चुके हैं, बल्कि गूगल और बिंग जैसे पुराने और पारंपरिक सर्च इंजन भी अब AI मोड के साथ आ चुके हैं। लेकिन AI का ये बढ़ता उपयोग एक नए खतरे की ओर भी इशारा करता है, जिसमें फेक या फिशिंग लिंक की समस्या सबसे आम है।

हाल में आई एक रिपोर्ट में पता चला है कि ChatGPT और Perplexity जैसे AI Tools पर शेयर की गई लिंक आपको फिशिंग साइट पर डायरेक्ट कर सकती हैं। आइए इस पूरे मामले के बारे में जानते हैं।

नेटक्राफ्ट की रिपोर्ट ने खोली पोल

हाल ही में प्रकाशित हुई Netcraft की एक रिपोर्ट के अनुसार, AI टूल्स से निकले लिंक हमेशा सुरक्षित नहीं होते। रिपोर्ट में बताया गया कि OpenAI के GPT-4.1 मॉडल से जब 50 अलग-अलग ब्रांड्स की लॉगइन वेबसाइट्स के लिंक मांगे गए (टेक, रिटेल, फाइनेंस और यूटिलिटी सेक्टर से जुड़ी कंपनियां), तो मॉडल ने सिर्फ 66% लिंक सही दिए। बाकी बचे हुए लिंक फेक वेबसाइट्स की ओर रीडायरेक्ट कर रहे थे, जो फिशिंग अटैक में बदल सकते हैं।

यह बेहद चिंताजनक है क्योंकि यूजर इन AI टूल्स पर पूरी तरह से भरोसा कर लेते हैं। अगर कोई यूजर ChatGPT या Perplexity जैसे टूल से किसी बैंक या ऑनलाइन प्लेटफॉर्म की वेबसाइट पूछता है और वह लिंक उसे किसी फिशिंग साइट पर ले जाए, तो उसका डेटा चोरी होने का खतरा बहुत ज्यादा होता है।

GitBook पर बने 17,000 से ज्यादा फेक पेज

रिपोर्ट में यह भी सामने आया कि GitBook पर AI के जरिए बनाए गए 17,000 से अधिक फेक पेज सामने आए हैं। ये पेज खासतौर पर क्रिप्टो यूजर्स को निशाना बनाते हैं और खुद को किसी लीगल हेल्प या प्रोडक्ट डॉक्युमेंटेशन साइट के रूप में पेश करते हैं। ये पेज काफी प्रोफेशनल दिखते हैं और AI सर्च में आसानी से आ जाते हैं। इसी वजह से यूजर्स को लगता है कि यह लिंक असली हैं, जबकि वे असल में फिशिंग पेज होते हैं।

Perplexity में भी देखी गई गड़बड़ी

Perplexity AI मॉडल से जब Wells Fargo बैंक की वेबसाइट मांगी गई, तो उसने भी एक फेक URL साझा किया जो फिशिंग साइट थी। Netcraft की रिसर्च में ऐसे कई उदाहरण पाए गए जहां AI मॉडल्स ने बिना वेरिफाई किए गलत और हानिकारक लिंक यूजर्स को दिए।

OpenAI CEO ने भी दी थी चेतावनी

Netcraft की इस रिपोर्ट के बाद, OpenAI के CEO द्वारा हाल ही में दी गई चेतावनी को और बल मिलता है। उन्होंने कहा था कि यूजर्स को AI मॉडल्स पर पूरी तरह से भरोसा नहीं करना चाहिए, खासकर जब बात वेब लिंक या सेंसिटिव जानकारी की हो।

यूजर्स क्या सावधानी बरतें?

- AI टूल्स से मिले किसी भी लिंक को बिना जांचे न खोलें।

- हमेशा ऑफिशियल वेबसाइट या ऐप से ही लॉगइन करें।

- यदि किसी लिंक पर क्लिक करें, तो URL को ध्यान से जांचें।

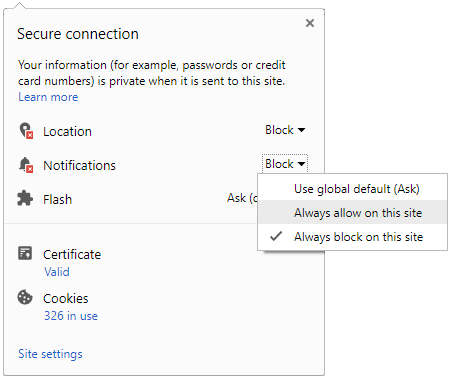

- फिशिंग से बचने के लिए दो-स्टेप वेरिफिकेशन और सिक्योर ब्राउजर एक्सटेंशन का इस्तेमाल करें।

AI ने हमारी जिंदगी को आसान जरूर बनाया है, लेकिन इससे जुड़े खतरे भी कम नहीं हैं। Netcraft की रिपोर्ट ने यह साफ कर दिया है कि चाहे वो ChatGPT हो या Perplexity, AI से मिले लिंक पर आँख बंद करके भरोसा करना खतरनाक हो सकता है। आने वाले समय में यदि इन AI टूल्स को ज्यादा सुरक्षित नहीं बनाया गया, तो यह समस्या एक बड़े साइबर खतरे में बदल सकती है। ऐसे में जरूरी है कि यूजर्स खुद सतर्क रहें और हर लिंक को सोच-समझकर खोलें।

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)